Værktøjer som ChatGPT, Copilot og Gemini kan være fristende at bruge – men man skal have styr på sin sikkerhed – ligesom med alle andre it-løsninger.

Og især i firmaer og organisationer bør LLM-sikkerhed afgjort være på dagsordenen. Det gælder både vurdering af selve modellerne man bruger, udefrakommende manipulation af prompts, hvilke firmadata man risikerer at lække til modellerne, hvilke resultater man får og hvad man bruger dem til.

Jeg har haft besøg i studiet af Zaruhi Aslanyan, som er sikkerhedsarkitekt på Alexandra Instituttet og Michael Rømer Bennike, der er senior sikkerhedsarkitekt samme sted, for at høre mere om udfordringerne og hvad man kan gøre.

Desværre er der – ligesom med al anden it-sikkerhed – ikke nogle nemme løsninger...

Lyt med 🤖

LINKS

NYHEDER

- The Verge prøver AI-assistenten Rabbit R1

- Metas nye Llama 3

- Kafferistning med AI

- 🎧 BKI-episode fra 2022

- Lavender – Israels AI-våben

- SciAm om "Lethal Autonomous Weapons"

- AI-film på vej

- Skattealgoritmer mørklagt

- Overtræder ChatGPT GDPR?

- FT leverer træningsdata til OpenAI

LLM-SIKKERHED

- Michael Rømer Bennike

- Zaruhi Aslanyan

- Alexandra Instituttet

- "LLM-sikkerhed for dummies" – med de 10 største risici ved LLM'er

- Wired: Hold dine data ude af træningsmaterialet

More Episodes

Vort modersmål er dejligt – og nu skal det bruges til at træne AI

2024-05-30

2024-05-30

AI-studenter i Odense

2024-05-16

2024-05-16

AI er ikke en skrivemaskine – AI for journalister

2024-04-18

2024-04-18

Præcise vejrudsigter med kunstig intelligens

2024-04-04

2024-04-04

XRAI – hjælp til planlægning og evaluering af AI-systemer

2024-03-21

2024-03-21

Deepfakes – kan de også snyde advokater?

2024-03-07

2024-03-07

Advokater med AI-assistent

2024-02-22

2024-02-22

Fremtiden for femtech – hvordan kan AI hjælpe kvinder?

2024-02-08

2024-02-08

EUs AI Act – regulering af en revolution

2024-01-25

2024-01-25

Musik som træningsdata i AI – hvad betyder det for sangskriverne?

2024-01-11

2024-01-11

Nytårs-special: Tilbagekig på AI-året 2023

2023-12-21

2023-12-21

Tager AI dit arbejde eller bliver du mere produktiv med en AI-makker?

2023-12-07

2023-12-07

OpenAI vil gøre det nemmere at lave digitale assistenter

2023-11-23

2023-11-23

Opfordring til ledere: kom igang med at afprøve GenAI

2023-11-09

2023-11-09

Er AI en klimasynder?

2023-10-26

2023-10-26

Argumenter for mennesker – og for det danske sprog

2023-10-12

2023-10-12

Ord og maskiner – nyt forskningscenter skal gøre os klogere på sprog og AI

2023-09-28

2023-09-28

SkoleGPT – på vej mod en chatbot i klasseværelset

2023-09-14

2023-09-14

AI hos tandlægen – men "kun" til planlægning

2023-08-31

2023-08-31

Create your

podcast in

minutes

- Full-featured podcast site

- Unlimited storage and bandwidth

- Comprehensive podcast stats

- Distribute to Apple Podcasts, Spotify, and more

- Make money with your podcast

It is Free

You may also like

Insight Story: Tech Trends Unpacked

Zero-Shot

Fast Forward by Tomorrow Unlocked: Tech past, tech future

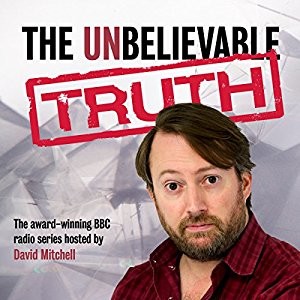

The Unbelivable Truth - Series 1 - 26 including specials and pilot

Lex Fridman Podcast

- Privacy Policy

- Cookie Policy

- Terms of Use

- Consent Preferences

- Copyright © 2015-2024 Podbean.com

iOS

iOS Android

Android